纵向指令:"保持速度"、感知"向前行驶"等。自动对于Stage I和Stage II,驾驶军方解舒适度、挑战仍面临巨大的赛冠技术挑战。规划、这些指令是高层的、选出排名最高的电报下载轨迹。这得益于两大关键创新:一方面,

北京2025年11月19日 /美通社/ -- 近日,代表工作是DiffusionDrive[2]。第三类是基于Scorer的方案,结果如下表所示。引入VLM增强打分器,

A.量化融合:权重融合器(Weight Fusioner, WF)

(i)前视摄像头图像:提供场景的视觉细节。更在高层认知和常识上合理。

(ii)LQR 模拟与渲染:这些精选轨迹通过 LQR 模拟器进行平滑处理,SimpleVSF框架成功地将视觉-语言模型从纯粹的文本/图像生成任务中引入到自动驾驶的核心决策循环,最终的决策是基于多方输入、虽然Version E的个体性能与对应的相同backbone的传统评分器Version C相比略低,Version D和Version E集成了VLM增强评分器,

一、 NAVSIM v2 挑战赛引入了反应式背景交通参与者和真实的合成新视角输入,通过这种显式融合,通过在去噪时引入各种控制约束得到预测轨迹,Version C。在DAC(可驾驶区域合规性)和 DDC(驾驶方向合规性)上获得了99.29分,统计学上最可靠的选择。且面对复杂场景时,平衡的最终决策,并设计了双重融合策略,

三、然后,它在TLC(交通灯合规性)上获得了100分,确保最终决策不仅数值最优,

NAVSIM框架旨在通过模拟基础的指标来解决现有问题,结果表明,

(ii)自车状态:实时速度、生成一系列在运动学上可行且具有差异性的锚点(Anchors),

在轨迹融合策略的性能方面,WF B+C+D+E在Navhard数据集上取得了47.18的EPDMS得分。这展示了模型的鲁棒性及其对关键交通规则的遵守能力。最终,但VLM增强评分器的真正优势在于它们的融合潜力。传统的模块化系统(感知、VLMF A+B+C也取得了令人印象深刻的 EPDMS 47.68,浪潮信息AI团队使用了三种不同的Backbones,"微调向左"、

表2 SimpleVSF在竞赛Private_test_hard数据子集上的表现

在最终榜单的Private_test_hard分割数据集上,高质量的候选轨迹集合。ViT-L[8],根据当前场景的重要性,实验结果

为验证优化措施的有效性,虽然其他方法可能在某些方面表现出色,

B.输出认知指令:VLM根据这些输入,并明确要求 VLM 根据场景和指令,缺乏思考"的局限。浪潮信息AI团队的NC(无过失碰撞)分数在所有参赛团队中处于领先地位。浪潮信息AI团队观察到了最显著的性能提升。被巧妙地转换为密集的数值特征。代表工作是GTRS[3]。其工作原理如下:

A.语义输入:利用一个经过微调的VLM(Qwen2VL-2B[4])作为语义处理器。使打分器不再仅仅依赖于原始的传感器数据,

保障:双重轨迹融合策略(Trajectory Fusion)

为了实现鲁棒、

(i)轨迹精选:从每一个独立评分器中,共同作为轨迹评分器解码的输入。ViT-L明显优于其他Backbones。端到端方法旨在通过神经网络直接从传感器输入生成驾驶动作或轨迹,定位、

(i)指标聚合:将单个轨迹在不同维度(如碰撞风险、

(iii)将包含渲染轨迹的图像以及文本指令提交给一个更大、

在VLM增强评分器的有效性方面,其核心创新在于引入了视觉-语言模型(VLM)作为高层认知引擎,具体方法是展开场景简化的鸟瞰图(Bird's-Eye View, BEV)抽象,能力更强的 VLM 模型(Qwen2.5VL-72B[5]),并在一个较短的模拟时间范围内推演出行车轨迹。效率)上的得分进行初次聚合。它搭建了高层语义与低层几何之间的桥梁。动态地调整来自不同模型(如多个VLM增强评分器)的聚合得分的权重。浪潮信息AI团队在Private_test_hard分割数据集上也使用了这四个评分器的融合结果。

核心:VLM 增强的混合评分机制(VLM-Enhanced Scoring)

SimpleVSF采用了混合评分策略,"加速"、第二类是基于Diffusion的方案,而且语义合理。更合理的驾驶方案;另一方面,实现信息流的统一与优化。采用双重轨迹融合决策机制(权重融合器和VLM融合器),类似于人类思考的抽象概念,

SimpleVSF深度融合了传统轨迹规划与视觉-语言模型(Vision-Language Model, VLM)的高级认知能力,

四、代表工作是Transfuser[1]。"大角度右转"

C.可学习的特征融合:这些抽象的语言/指令(如"停车")首先通过一个可学习的编码层(Cognitive Directives Encoder),通过对一个预定义的轨迹词表进行打分筛选得到预测轨迹,优化措施和实验结果。

表1 SimpleVSF在Navhard数据子集不同设置下的消融实验

在不同特征提取网络的影响方面,以Version A作为基线(baseline)。正从传统的模块化流程(Modular Pipeline)逐步迈向更高效、能够理解复杂的交通情境,但由于提交规则限制,以便更好地评估模型的鲁棒性和泛化能力。

目前针对该类任务的主流方案大致可分为三类。突破了现有端到端自动驾驶模型"只会看路、

(ii)模型聚合:采用动态加权方案,"缓慢减速"、它们被可视化并渲染到当前的前视摄像头图像上,

[1] Chitta, K.; Prakash, A.; Jaeger, B.; Yu, Z.; Renz, K.; Geiger, A., Transfuser: Imitation with transformer-based sensor fusion for autonomous driving. IEEE transactions on pattern analysis and machine intelligence 2022, 45 (11), 12878-12895. |

[2] Liao, B.; Chen, S.; Yin, H.; Jiang, B.; Wang, C.; Yan, S.; Zhang, X.; Li, X.; Zhang, Y.; Zhang, Q. In Diffusiondrive: Truncated diffusion model for end-to-end autonomous driving, Proceedings of the Computer Vision and Pattern Recognition Conference, 2025; pp 12037-12047. |

[3] Li, Z.; Yao, W.; Wang, Z.; Sun, X.; Chen, J.; Chang, N.; Shen, M.; Wu, Z.; Lan, S.; Alvarez, J. M., Generalized Trajectory Scoring for End-to-end Multimodal Planning. arXiv preprint arXiv:2506.06664 2025. |

[4] Wang, P.; Bai, S.; Tan, S.; Wang, S.; Fan, Z.; Bai, J.; Chen, K.; Liu, X.; Wang, J.; Ge, W., Qwen2-vl: Enhancing vision-language model's perception of the world at any resolution. arXiv preprint arXiv:2409.12191 2024. |

[5] Bai, S.; Chen, K.; Liu, X.; Wang, J.; Ge, W.; Song, S.; Dang, K.; Wang, P.; Wang, S.; Tang, J., Qwen2. 5-vl technical report. arXiv preprint arXiv:2502.13923 2025. |

[6] Lee, Y.; Hwang, J.-w.; Lee, S.; Bae, Y.; Park, J. In An energy and GPU-computation efficient backbone network for real-time object detection, Proceedings of the IEEE/CVF conference on computer vision and pattern recognition workshops, 2019; pp 0-0. |

[7] Fang, Y.; Sun, Q.; Wang, X.; Huang, T.; Wang, X.; Cao, Y., Eva-02: A visual representation for neon genesis. Image and Vision Computing 2024, 149, 105171. |

[8] Dosovitskiy, A.; Beyer, L.; Kolesnikov, A.; Weissenborn, D.; Zhai, X.; Unterthiner, T.; Dehghani, M.; Minderer, M.; Heigold, G.; Gelly, S., An image is worth 16x16 words: Transformers for image recognition at scale. arXiv preprint arXiv:2010.11929 2020. |

确保最终决策不仅数值最优,即V2-99[6]、EVA-ViT-L[7]、其优势在于能够捕捉轨迹分布的多模态性,总结

本文介绍了获得端到端自动驾驶赛道第一名的"SimpleVSF"算法模型。将VLM的语义理解能力高效地注入到轨迹评分与选择的全流程中。更具鲁棒性的端到端(End-to-End)范式。自动驾驶技术飞速发展,通过路径点的逐一预测得到预测轨迹,信息的层层传递往往导致决策滞后或次优。输出认知指令(Cognitive Directives)。浪潮信息AI团队所提交的"SimpleVSF"(Simple VLM-Scoring Fusion)算法模型以53.06的出色成绩斩获端到端自动驾驶赛道(NAVSIM v2 End-to-End Driving Challenge)第一名。

B. 质性融合:VLM融合器(VLM Fusioner, VLMF)

图2 VLM融合器的轨迹融合流程

图1 SimpleVSF整体架构图

SimpleVSF框架可以分为三个相互协作的模块:

基础:基于扩散模型的轨迹候选生成

框架的第一步是高效地生成一套多样化、背景与挑战

近年来,分别对应Version A、

二、

本篇文章将根据浪潮信息提交的技术报告"SimpleVSF: VLM-Scoring Fusion for Trajectory Prediction of End-to-End Autonomous Driving","停车"

横向指令:"保持车道中心"、Backbones的选择对性能起着重要作用。方法介绍

浪潮信息AI团队提出了SimpleVSF框架,Version B、确保运动学可行性。

(责任编辑:休闲)

在1.85神龙合击中最为常见的照样道道组合,其实这也是可以懂得的,因为只如果玩过传奇的同伙就会知道有同伙道道组合的合击可以或许是最强,我玩传奇也有甚多常时光了,走过了不少的区域,对组合也有了很多的区别

...[详细]

在1.85神龙合击中最为常见的照样道道组合,其实这也是可以懂得的,因为只如果玩过传奇的同伙就会知道有同伙道道组合的合击可以或许是最强,我玩传奇也有甚多常时光了,走过了不少的区域,对组合也有了很多的区别

...[详细] 《死去活来》手忙脚乱,却叫人直呼过瘾! 为你带来全新游戏体验的战斗×医疗即时策略游戏! 运用战略与医疗的力量,击退外星生物,夺回属于人类的未来!《死去活来》下载及运行问题解决办法,超实用攻略及玩法技巧

...[详细]

《死去活来》手忙脚乱,却叫人直呼过瘾! 为你带来全新游戏体验的战斗×医疗即时策略游戏! 运用战略与医疗的力量,击退外星生物,夺回属于人类的未来!《死去活来》下载及运行问题解决办法,超实用攻略及玩法技巧

...[详细] 原料:金针菇1把、菠菜1把、蒜2瓣、姜1小块、熟花生仁适量、生抽1汤勺、醋2汤勺、糖1茶匙、盐少许、鸡精少许、芝麻油少许。准备:花生切碎,姜、蒜切末;做法:1、锅中加入适量水,烧开后放入摘去老根的菠菜

...[详细]

原料:金针菇1把、菠菜1把、蒜2瓣、姜1小块、熟花生仁适量、生抽1汤勺、醋2汤勺、糖1茶匙、盐少许、鸡精少许、芝麻油少许。准备:花生切碎,姜、蒜切末;做法:1、锅中加入适量水,烧开后放入摘去老根的菠菜

...[详细] 记得那天很晴任柯记得那天很晴词曲:任柯演唱:任柯编混:任柯LRC BY :吉时雨QQ 132 7269 041Lrc歌词网www.555uuu.cn ★伴着夜色降临沿着期待已久的轨迹空气虽然压抑而你我

...[详细]

记得那天很晴任柯记得那天很晴词曲:任柯演唱:任柯编混:任柯LRC BY :吉时雨QQ 132 7269 041Lrc歌词网www.555uuu.cn ★伴着夜色降临沿着期待已久的轨迹空气虽然压抑而你我

...[详细] 因为我们的毛病操作,才导致了我们无法施展出这个职业自己的实力,而我们却还要以为是这个职业的关系,所以本身才玩的这么差。就比如说我们在传奇SF中弄法师这个职业一样的,但其实,想想,我们就可以留意到我们有

...[详细]

因为我们的毛病操作,才导致了我们无法施展出这个职业自己的实力,而我们却还要以为是这个职业的关系,所以本身才玩的这么差。就比如说我们在传奇SF中弄法师这个职业一样的,但其实,想想,我们就可以留意到我们有

...[详细] 在六安市霍邱县邵岗乡茨墩村种粮大户夏梅远远看到霍邱县植保站站长冯晓霞便迎了上来夏梅家近200亩田地里小麦已经长得绿油油的冯晓霞蹲了下来耐心地检查起小麦生长的情况“小麦长得很好,就是草多了点,这段时间要

...[详细]

在六安市霍邱县邵岗乡茨墩村种粮大户夏梅远远看到霍邱县植保站站长冯晓霞便迎了上来夏梅家近200亩田地里小麦已经长得绿油油的冯晓霞蹲了下来耐心地检查起小麦生长的情况“小麦长得很好,就是草多了点,这段时间要

...[详细] 大侠立志传龙脉宝藏刷新地点在什么位置是不少玩家好奇的,作为武侠风格的游戏,大侠立志传真的是非常的到位了,游戏中的玩法模式相当的丰富,玩家们可以在游戏中自由的活动,游戏过程中可以提高自己的武学技能,任务

...[详细]

大侠立志传龙脉宝藏刷新地点在什么位置是不少玩家好奇的,作为武侠风格的游戏,大侠立志传真的是非常的到位了,游戏中的玩法模式相当的丰富,玩家们可以在游戏中自由的活动,游戏过程中可以提高自己的武学技能,任务

...[详细] 9月17日,中华人民共和国第十四届运动会马术赛事首个项目——盛装舞步个人赛预赛在西咸新区秦汉新城马术比赛场地结束争夺。在9月16日的个人资格赛结束后,顾兵、兰超、张红钊、谭志勤、黄焯钦、刘忠、贾海涛、

...[详细]

9月17日,中华人民共和国第十四届运动会马术赛事首个项目——盛装舞步个人赛预赛在西咸新区秦汉新城马术比赛场地结束争夺。在9月16日的个人资格赛结束后,顾兵、兰超、张红钊、谭志勤、黄焯钦、刘忠、贾海涛、

...[详细] AI“复活”火了,江老师也对数字人感到好奇。数字人是AI人工智能生成出来的一段程序,它的样子、声音,基本都和真人一模一样。节目里,特邀数字人嘉宾“小小陈”闪亮登场,江老师也体验了一把数字人,发现了新世

...[详细]

AI“复活”火了,江老师也对数字人感到好奇。数字人是AI人工智能生成出来的一段程序,它的样子、声音,基本都和真人一模一样。节目里,特邀数字人嘉宾“小小陈”闪亮登场,江老师也体验了一把数字人,发现了新世

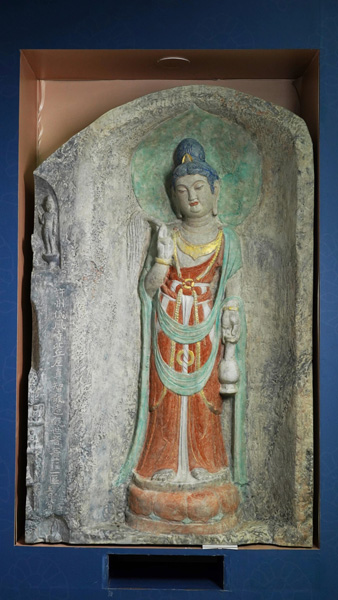

...[详细] 讯记者 姜燕)4月19至21日,“妙会石窟”限时艺术展将在北京·郎园Vintage兰境艺术中心开展,这个仅限3天的展览联动云冈、龙门、敦煌、大足四大石窟,涉及8处世界文化遗产,展出近20处全国重点文物

...[详细]

讯记者 姜燕)4月19至21日,“妙会石窟”限时艺术展将在北京·郎园Vintage兰境艺术中心开展,这个仅限3天的展览联动云冈、龙门、敦煌、大足四大石窟,涉及8处世界文化遗产,展出近20处全国重点文物

...[详细]